что это такое, и как это может быть выгодно вашей компании

Компания-разработчик мобильных приложений MOBGEN опубликовала на портале Medium.com статью, в которой рассказала о существующих решениях, принципах работы и перспективах развития технологий в области распознавания изображений. Как эта технология устроена, и как это может помочь вашему бизнесу, читайте далее.

Что такое технология распознавания изображений?

Распознавание изображений (некоторые также называют «компьютерным зрением») это технология, которая создана получать, обрабатывать, анализировать, и понимать изображения реального мира, с целью предоставить цифровую или символьную информацию.

Что вы сказали?

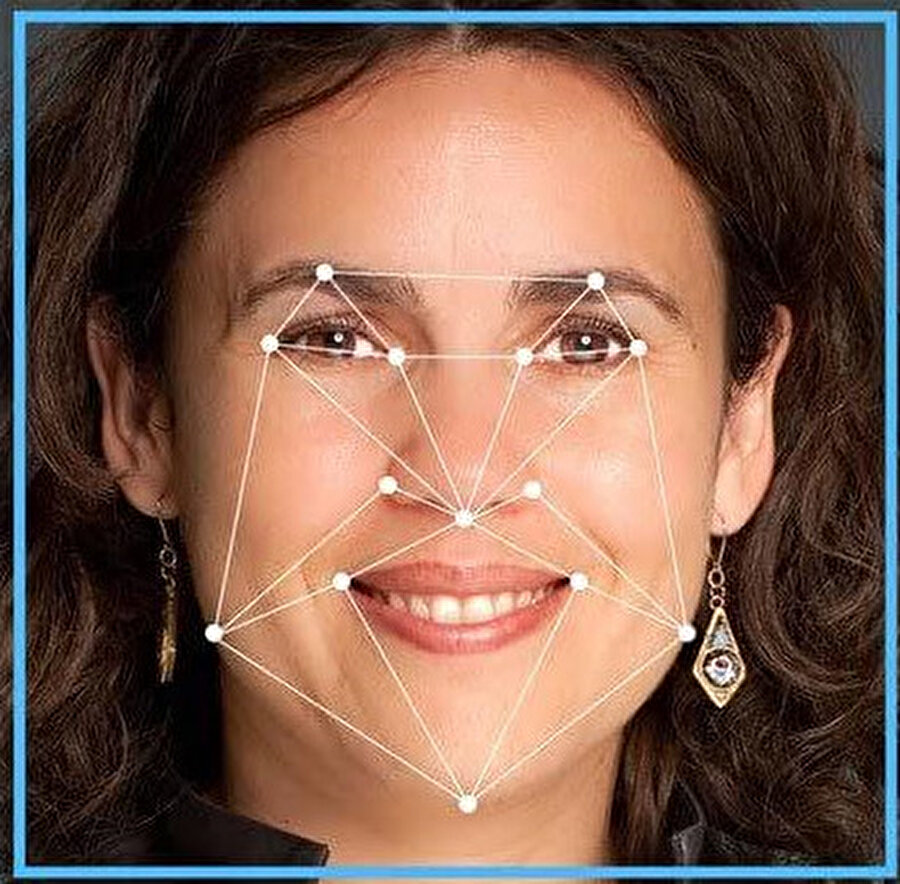

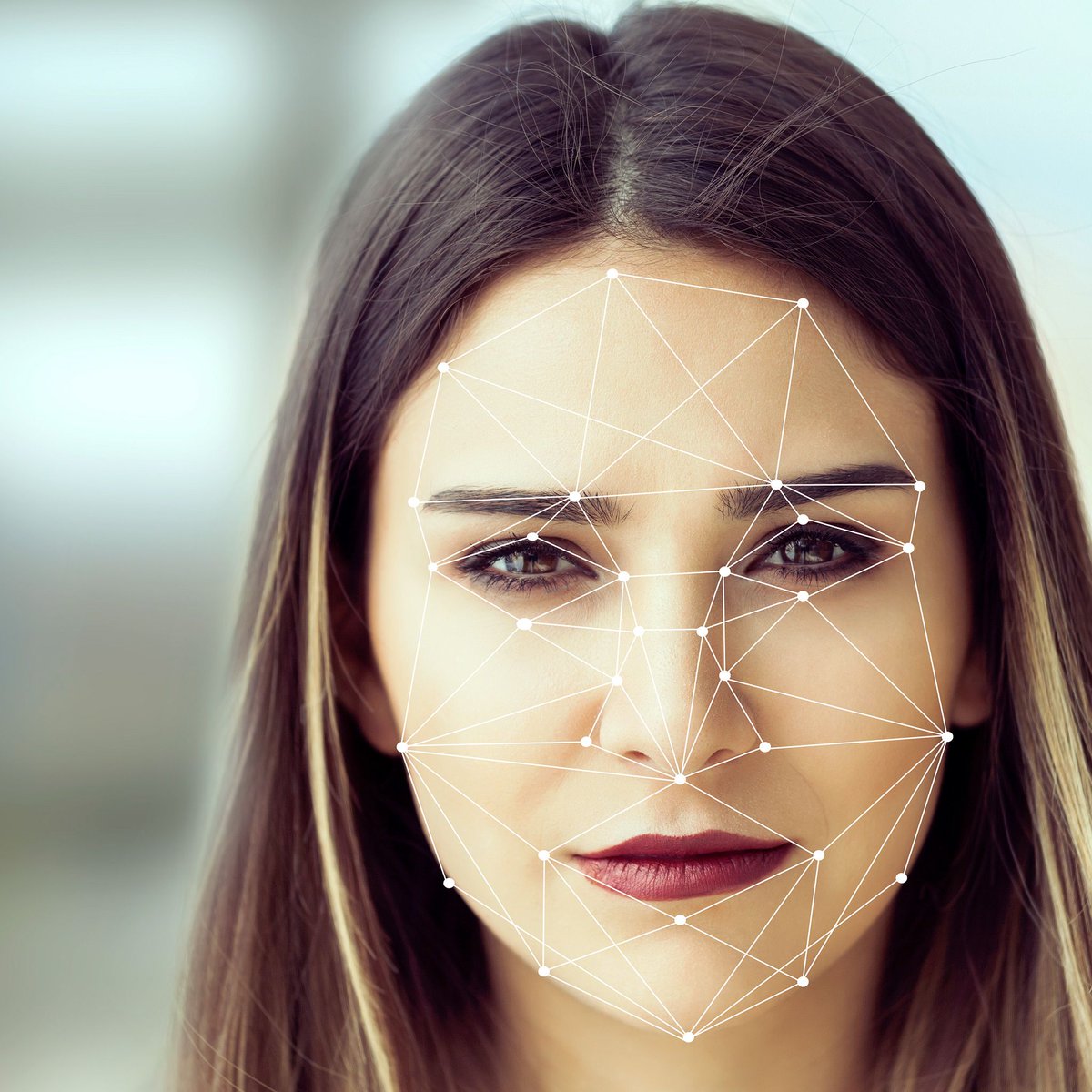

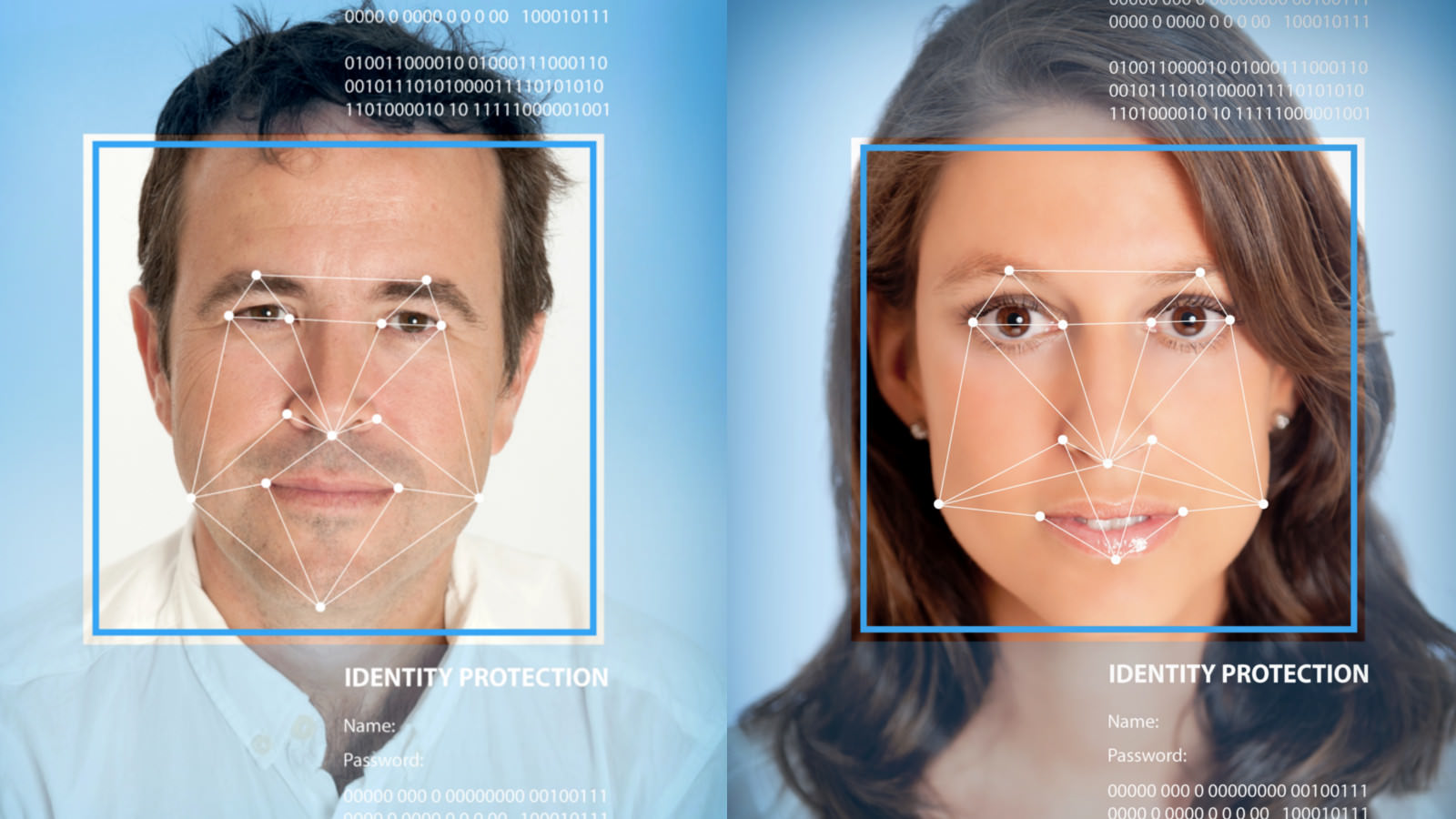

Не беспокойтесь. Мы понимаем, что это сложно. Позвольте перефразировать: когда вы загружаете свою фотографию, или фотографию ваших друзей на Facebook, все лица будут распознаны и пользователи будут автоматически отмечены: это и называется распознаванием изображений.

Хорошо, это звучит намного понятнее

Прекрасно! Потому что сейчас будет еще сложнее… Компьютерное зрение – очень широкая область компьютерных наук, так как сюда вовлечено множество аспектов, таких как машинное обучение, интеллектуальный анализ данных, расширение базы знаний, распознавание шаблонов, и другие. Исследования в данной области привели к технологиям, которые имитируют человеческое зрение. И для того, чтобы создать программное обеспечение, способное видеть, вам для начала понадобится пара линз.

Что вы имеете в виду?

Я имею в виду, что для того, чтобы обработать изображение, вам для начала нужно его снять с помощью камеры. Затем, программное обеспечение извлекает из него необходимую информацию, и после этого, совершает действия, основываясь на полученных данных. До недавних пор, цифровые камеры были неприлично дорогими, имели очень низкое разрешение, и распознавание изображений было невозможно совершать в режиме реального времени. Но с приходом мобильных телефонов и высокоскоростных камер, возможности стали безграничны.

Это невозможно…

Я так не думаю. Вот ссылка на это видео. Робот использует высокоскоростные камеры для распознавания движения руки человека. Анализируя шаблоны движения руки со скоростью 500 кадров в секунду, робот способен немедленно реагировать в ответ, и в результате выигрывать. Чтобы этого добиться, камера захватывает изображение очертаний руки, формирует объект и отравляет информацию программному обеспечению, которое распознает шаблон и генерирует реакцию робота в ответ. Объект руки человека формируется 60 мс, и затем робот выполняет все вышеперечисленное за 1 мс.

Хорошо, но я думал, что речь пойдет о мобильных …

Не беспокойтесь, мы дойдем и до этого. Одной из самых вызывающих и перспективных областей является обработка и распознавание изображений для имитации человеческого зрения: восприятия изображения, обработки и дальнейшей реакции.

Самое важное направление в алгоритмах распознавания шаблонов — вероятностная классификация. Когда изображение сравнивается с набором других сохраненных изображений, задается значение (вероятность) для каждого другого изображения, с которым оно совпадает. Комбинируя несколько алгоритмов вероятностных классификаций, которые применяются к тому же набору изображений, называемых «ансамблем», предоставляется итоговая оценка для каждого изображения, которая затем используется программой для предположения, на какие изображение это похоже.

Как вы могли представить, это довольно сложно для мобильного устройства. Вы можете подумать, что мощность процессора является проблемой. Так и есть! И самое тонкое место — база данных изображений, с которыми сравнивается оригинал. На примере робота, о котором уже говорилось, Вы можете иметь только ограниченное количество изображений (камень, ножницы, бумага), с которыми можно работать, но в примере с распознаванием изображений в Facebook, невозможно сохранять лица каждого человека, кто зарегистрирован в социальной сети на мобильном устройстве (это не совсем тот способ, по которому работает данная функция; Facebook сохраняет уникальный хэш для каждого человека, используя определенные характеристики лица как основу, но пример был предоставлен исключительно для того, чтоб объяснить идею).

Вы можете подумать, что мощность процессора является проблемой. Так и есть! И самое тонкое место — база данных изображений, с которыми сравнивается оригинал. На примере робота, о котором уже говорилось, Вы можете иметь только ограниченное количество изображений (камень, ножницы, бумага), с которыми можно работать, но в примере с распознаванием изображений в Facebook, невозможно сохранять лица каждого человека, кто зарегистрирован в социальной сети на мобильном устройстве (это не совсем тот способ, по которому работает данная функция; Facebook сохраняет уникальный хэш для каждого человека, используя определенные характеристики лица как основу, но пример был предоставлен исключительно для того, чтоб объяснить идею).

Чтоб решить эту и другие проблемы, распознавание изображений обычно выполняется на стороне сервера, где процессорная мощность, либо место для хранения данных не представляет проблем. Мобильные устройства могут просто отправлять изображение, и нейронная сеть или оборудование обработают запрос.

Одну минуту! Я видел, как это работает на мобильных устройствах без соединения с интернетом

Да, но тут только часть правды. Мобильному устройству все еще необходимо отправлять изображения на сервер, также как и серверу необходимо хранить их. Как только изображения окажутся там, сервер обработает изображение, сгенерирует намного меньший хэш, и вернет обратно в приложение. И затем, к примеру, вы можете зайти в режим полета и увидеть изображение на камере телефона, сравнение будет сделано в режиме оффлайн.

Спасибо за все эти объяснения. Теперь поговорим о деле

Baidu разработали прототип DuLight: продукт для распознавания объектов, который поможет слепым «видеть» с помощью снимков всего, что их окружает и передавая обработанные данные через наушник. Однако, на продукцию в области искусственного интеллекта обычно налагаются этические и законодательные ограничения. Возьмем, к примеру, автомобильную индустрию и беспилотные автомобили от Google. Технология готова, но предстоит еще долгий процесс, прежде чем эти машины появятся на рынке.

Baidu разработали прототип DuLight: продукт для распознавания объектов, который поможет слепым «видеть» с помощью снимков всего, что их окружает и передавая обработанные данные через наушник. Однако, на продукцию в области искусственного интеллекта обычно налагаются этические и законодательные ограничения. Возьмем, к примеру, автомобильную индустрию и беспилотные автомобили от Google. Технология готова, но предстоит еще долгий процесс, прежде чем эти машины появятся на рынке. Хорошо, но я не планирую строить беспилотный автомобиль – что может технология распознавания изображений дать моему бизнесу?

Честно говоря, многое! Существует множество мелкомасштабных методов применения технологии распознавания изображений для получения преимуществ. Так как мы говорим о мобильных устройствах, давайте рассмотрим некоторые примеры использования технологии распознавания изображений в мобильной связи. Одним из крупнейших игроков в этой области является Blippar: платформа для визуального обнаружения, которая позволяет пользователям сканировать объекты и получать их описание, что делает физический мир интерактивным игровым полем.

Но существуют и такие маркетинговые компании, такие как Makeup Genius, TrackMyMaccas, и SnapFindShop, на которые стоит взглянуть. Эти брэнды применяют распознавание изображений для изучения социального обмена и привлечения пользователей.

Так вы говорите, что технология распознавания изображений может помочь мне привлечь клиентов?

Так как мы говорим о мобильных технологиях, слово «привлечение» так или иначе, всплыло бы в течение разговора. Мир приложений вращается вокруг привлечения пользователей: если вы не преуспели в этом, то есть шанс, что пользователь просто никогда не вернется к использованию вашего приложения. Распознавание изображений даст вашему приложению огромные возможности для расширения, поскольку технология позволит Вам выйти за пределы мобильного устройства в физический мир пользователя. Ваше приложение сможет предоставить что-то более материальное, что позволит создать сильную эмоциональную связь.

Чтобы распознавать картинки, не нужно распознавать картинки / Хабр

Посмотрите на это фото.Это совершенно обычная фотография, найденная в Гугле по запросу «железная дорога». И сама дорога тоже ничем особенным не отличается.

Что будет, если убрать это фото и попросить вас нарисовать железную дорогу по памяти?

Если вы ребенок лет семи, и никогда раньше не учились рисовать, то очень может быть, что у вас получится что-то такое:

Упс. Кажется, что-то пошло не так.

Давайте еще раз вернемся к рельсам на первой картинке и попробуем понять, что не так.

На самом деле, если долго разглядывать ее, становится понятно, что она не совсем точно отображает окружающий мир. Главная проблема, о которую мы немедленно споткнулись — там, например, пересекаются параллельные прямые. Ряд одинаковых (в реальности) фонарных столбов на самом деле изображен так, что каждый следующий столб имеет все меньшие и меньшие размеры.

Все это — эффекты перспективы, последствия того, что трехмерные объекты снаружи проецируются на двумерную сетчатку внутри глаза. Ничего отдельно магического в этом нет — разве что немного любопытно, почему эти искажения контуров и линий не вызывают у нас никаких проблем при ориентации в пространстве, но вдруг заставляют мозг напрячься при попытке взяться за карандаш.

Еще один замечательный пример — как маленькие дети рисуют небо.

Небо должно быть наверху — вот она, синяя полоска, пришпиленная к верхнему краю. Середина листа при этом остается белой, заполнена пустотой, в которой плавает солнце.

И так происходит всегда и везде. Мы знаем, что куб состоит из квадратных граней, но посмотрите на картинку, и вы не увидите там ни одного прямого угла — более того, эти углы постоянно меняются, стоит сменить угол обзора. Как будто где-то в голове у нас сохранена грубая схема правильного, трехмерного объекта, и именно к ней мы обращаемся в процессе рисования рельс, не сразу успевая сопоставить результат с тем, что видим своими глазами.

Как будто где-то в голове у нас сохранена грубая схема правильного, трехмерного объекта, и именно к ней мы обращаемся в процессе рисования рельс, не сразу успевая сопоставить результат с тем, что видим своими глазами.

На самом деле все еще хуже. Каким образом, например, на самой первой картинке с дорогой мы определяем, какая часть дороги расположена ближе к нам, а какая дальше? По мере удаления предметы становятся меньше, ок — но вы уверены, что кто-то не обманул вас, коварно разместив друг за другом последовательно уменьшающиеся шпалы? Далекие объекты обычно имеют бледно-голубоватый оттенок (эффект, который называется «атмосферная перспектива») — но предмет может быть просто окрашен в такой цвет, и в остальном казаться совершенно нормальным. Мост через железнодорожные пути, который едва видно отсюда, кажется нам находящимся позади, потому что его заслоняют фонари (эффект окклюзии) — но опять-таки, как вы можете быть уверены, что фонари просто не нарисованы на его поверхности? Весь этот набор правил, с помощью которых вы оцениваете трехмерность сцены, во многом зависит от вашего опыта, и возможно, генетического опыта ваших предков, обученных выживать в условиях нашей атмосферы, падающего сверху света и ровной линии горизонта.

Сама по себе, без помощи мощной аналитической программы в вашей голове, наполненной этим визуальным опытом, любая фотография говорит об окружающем мире ужасно мало. Изображения — это скорее такие триггеры, заставляющие вас мысленно представить себе сцену, большая часть знаний о которой уже есть у вас в памяти. Они не содержат реальных предметов — только ограниченные, сплющенные, трагически двумерные представления о них, которые, к тому же, постоянно меняются при движении. В чем-то мы с вами — такие же жители Флатландии, которые могут увидеть мир только с одной стороны и неизбежно искаженным.

Попробуйте выглянуть в окно и подумать, что то, что вы видите — обман, искажение, безнадежная неполноценность.

Попробуйте выглянуть в окно и подумать, что то, что вы видите — обман, искажение, безнадежная неполноценность.Представьте, что вы — нейронная сеть.

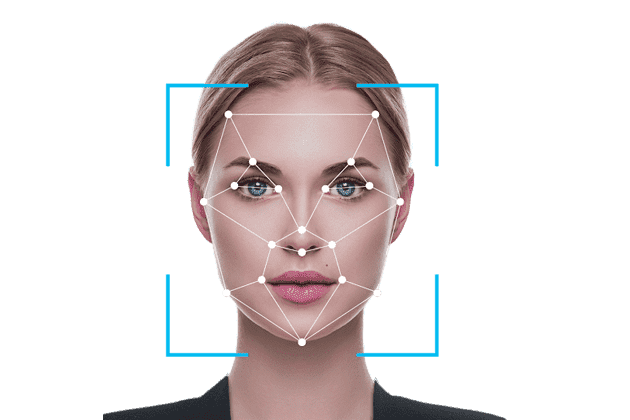

Это не должно быть очень сложно — в конце концов, как-то так оно и есть на самом деле. Вы проводите свободное время за распознаванием лиц на документах в паспортном столе. Вы — очень хорошая нейронная сеть, и работа у вас не слишком сложная, потому что в процессе вы ориентируетесь на паттерн, строго характерный именно для человеческих лиц — взаимное расположение двух глаз, носа и рта. Глаза и носы сами по себе могут различаться, какой-то один из признаков иногда может оказаться на фотографии неразличимым, но вам всегда помогает наличие других. И вдруг вы натыкаетесь вот на такое:

Хм, думаете вы. Вы определенно видите что-то знакомое — по крайней мере, в центре, кажется, есть один глаз. Правда, странной формы — он похож на треугольник, а не на заостренный овал. Второго глаза не видно. Нос, который должен располагаться посередине и между глаз, уехал куда-то совсем в край контура, а рта вы вообще не нашли — опредленно, темный уголок снизу-слева совсем на него не похож. Не лицо — решаете вы, и выбрасываете картинку в мусорное ведро.

Не лицо — решаете вы, и выбрасываете картинку в мусорное ведро.

Так бы мы думали, если бы наша зрительная система занималась простым сопоставлением паттернов в изображениях. К счастью, думает она как-то по-другому. У нас не вызывает никакого беспокойства отсутствие второго глаза, от этого лицо не становится менее похожим на лицо. Мы мысленно прикидываем, что второй глаз должен находиться по ту сторону, и форма его обусловлена исключительно тем, что голова на фото повернута и смотрит в сторону. Кажется невозможно тривиальным, когда пытаешься это объяснить на словах, но кое-кто с вами бы на полном серьезе не согласился.

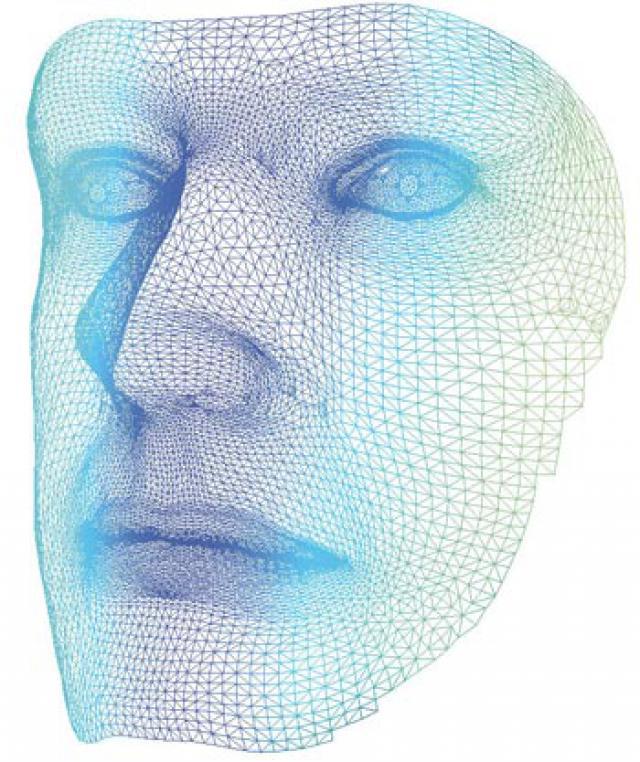

Самое обидное, что не видно, как можно решить этот вопрос механическим способом. Компьютерное зрение сталкивалось с соответствующими проблемами очень давно, с момента своего появления, и периодически находило эффективные частные решения — так, мы можем опознать сдвинутый в сторону предмет, последовательно передвигая свой проверочный паттерн по всему изображению (чем успешно пользуются сверточные сети), можем справляться с отмасштабированными или повернутыми картинками с помощью признаков SIFT, SURF и ORB, но эффекты перспективы и поворот предмета в пространстве сцены — похоже, вещи качественно другого уровня. Здесь нам нужно знать, как предмет выглядит со всех сторон, получить его истинную трехмерную форму, иначе нам не с чем работать. Поэтому чтобы распознавать картинки, не нужно распознавать картинки. Они лживы, обманчивы и заведомо неполноценны. Они — не наши друзья.

Здесь нам нужно знать, как предмет выглядит со всех сторон, получить его истинную трехмерную форму, иначе нам не с чем работать. Поэтому чтобы распознавать картинки, не нужно распознавать картинки. Они лживы, обманчивы и заведомо неполноценны. Они — не наши друзья.

Итак, важный вопрос — как бы нам получать трехмерную модель всего, что мы видим? Еще более важный вопрос — как при этом обойтись без необходимости покупать лазерный пространственный сканер (сначала я написал «чертовски дорогой лазерный сканер», а потом наткнулся на этот пост)? Даже не столько по той причине, что нам жалко, а потому, что животные в процессе эволюции зрительной системы явно каким-то образом обошлись без него, одними только глазами, и было бы любопытно выяснить, как они так.

Где-то в этом месте часть аудитории обычно встает и выходит из зала, ругаясь на топтание по матчасти — все знают, что для восприятия глубины и пространства мы пользуемся бинокулярным зрением, у нас для этого два специальных глаза! Если вы тоже так думаете, у меня для вас небольшой сюрприз — это неправда. Доказательство прекрасно в своей простоте — достаточно закрыть один глаз и пройтись по комнате, чтобы убедиться, что мир внезапно не утратил глубины и не стал походить на плоский аналог анимационного мультфильма. Еще один способ — вернуться и снова посмотреть на фотографию с железной дорогой, где замечательно видно глубину даже при том, что она расположена на полностью плоской поверхности монитора.

Доказательство прекрасно в своей простоте — достаточно закрыть один глаз и пройтись по комнате, чтобы убедиться, что мир внезапно не утратил глубины и не стал походить на плоский аналог анимационного мультфильма. Еще один способ — вернуться и снова посмотреть на фотографию с железной дорогой, где замечательно видно глубину даже при том, что она расположена на полностью плоской поверхности монитора.

Для некоторых действий они, похоже, и правда приносят пользу с точки зрения оценки пространственного положения. Возьмите два карандаша, закройте один глаз и попытайтесь сдвигать эти карандаши так, чтобы они соприкоснулись кончиками грифелей где-то вблизи вашего лица. Скорее всего, грифели разойдутся, причем ощутимо (если у вас получилось легко, поднесите их еще ближе к лицу), при этом со вторым открытым глазом такого не происходит. Пример взят из книги Марка Чангизи «Революция в зрении» — там есть целая глава о стереопсисе и бинокулярном зрении с любопытной теорией о том, что два смотрящих вперед глаза нужны нам для того, чтобы видеть сквозь мелкие помехи вроде свисающих листьев. Кстати, забавный факт — на первом месте в списке преимуществ бинокулярного зрения в Википедии стоит «It gives a creature a spare eye in case one is damaged».

Кстати, забавный факт — на первом месте в списке преимуществ бинокулярного зрения в Википедии стоит «It gives a creature a spare eye in case one is damaged».

Итак, бинокулярное зрение нам не подходит — и вместе с ним мы отвергаем стереокамеры, дальномеры и Kinect. Какой бы ни была способость нашей зрительной системы воссоздавать трехмерные образы увиденного, она явно не требует наличия двух глаз. Что остается в итоге?

Я ни в коем случае не готов дать точный ответ применительно к биологическом зрению, но пожалуй, для случая абстрактного робота с камерой вместо глаза остался один многообещающий способ. И этот способ — движение.

Вернемся к теме поездов, только на этот раз выглянем из окна:

То, что мы при этом видим, называется «параллакс движения», и вкратце он заключается в том, что когда мы двигаемся вбок, близкие предметы смещаются в поле зрения сильнее, чем далекие. Для движения вперед/назад и поворотов тоже можно сформулировать соответствующие правила, но давайте их пока проигнорируем. Итак, мы собираемся двигаться, оценивать смещения предметов в кадре и на основании этого определять их расстояние от наблюдателя — техника, которая официально называется «structure-from-motion». Давайте попробуем.

Итак, мы собираемся двигаться, оценивать смещения предметов в кадре и на основании этого определять их расстояние от наблюдателя — техника, которая официально называется «structure-from-motion». Давайте попробуем.

Прежде всего — а не сделали ли все, случайно, до нас? Страница «Structure from motion» в Википедии предлагает аж тринадцать инструментов (и это только опенсорсных) для воссоздания 3D-моделей из видео или набора фотографий, большинство из них пользуются подходом под названием bundle adjustment, а самым удобным мне показался Bundler (и демо-результаты у него крутые). К сожалению, тут возникает проблема, с которой мы еще столкнемся — Bundler для корректной работы хочет знать от нас модель камеры и ее внутренние параметры (в крайнем случае, если модель неизвестна, он требует указать фокусное расстояние).

Если для вашей задачи это не проблема — можете смело бросать чтение, потому что это самый простой и одновременно эффективный метод (а знаете, кстати, что примерно таким способом делались модели в игре «Исчезнование Итана Картера»?). Для меня, увы, необходимость быть привязанным к модели камеры — это условие, которого очень хотелось бы избежать. Во-первых, потому что у нас под боком полный ютуб визуального видео-опыта, которым хотелось бы в будущем пользоваться в качестве выборки. Во-вторых (и это, может быть, даже важнее), потому что наш с вами человеческий мозг, похоже, если и знает в цифрах внутренние параметры камеры наших глаз, то прекрасно умеет приспосабливаться к любым оптическим искажениями. Взгляд через объектив широкофокусной камеры, фишай, просмотр кино и ношение окулусрифта совершенно не разрушает ваших зрительных способностей. Значит, наверное, возможен и какой-то другой путь.

Для меня, увы, необходимость быть привязанным к модели камеры — это условие, которого очень хотелось бы избежать. Во-первых, потому что у нас под боком полный ютуб визуального видео-опыта, которым хотелось бы в будущем пользоваться в качестве выборки. Во-вторых (и это, может быть, даже важнее), потому что наш с вами человеческий мозг, похоже, если и знает в цифрах внутренние параметры камеры наших глаз, то прекрасно умеет приспосабливаться к любым оптическим искажениями. Взгляд через объектив широкофокусной камеры, фишай, просмотр кино и ношение окулусрифта совершенно не разрушает ваших зрительных способностей. Значит, наверное, возможен и какой-то другой путь.

Итак, мы печально закрыли страницу с Итаном Картером википедии и опускаемся на уровень ниже — в OpenCV, где нам предлагают следующее:

1. Взять два кадра, снятые с откалиброванной камеры.

2. Вместе с параметрами калибровки (матрицей камеры) положить их оба в функцию stereoRectify, которая выпрямит (ректифицирует) эти два кадра — это преобразование, которое искажает изображение так, чтобы точка и ее смещение оказывались на одной горизонтальной прямой.

3. Эти ректифицированые кадры мы кладем в функцию stereoBM и получаем карту смещений (disparity map) — такую картинку в оттенках серого, где чем пиксель ярче, тем большее смещение он выражает (по ссылке есть пример).

4. Полученную карту смещений кладем в функцию с говорящим названием reprojectImageTo3D (понадобится еще и матрица Q, которую в числе прочих мы получим на шаге 2). Получаем наш трехмерный результат.

Черт, похоже, мы наступаем на те же грабли — уже в пункте 1 от нас требуют откалиброванную камеру (правда, OpenCV милостиво дает возможность сделать это самому). Но погодите, здесь есть план Б. В документации прячется функция с подозрительным названием stereoRectifyUncalibrated…

План Б:

1. Нам нужно оценить примерную часть смещений самим — хотя бы для ограниченного набора точек. StereoBM здесь не подойдет, поэтому нам нужен какой-то другой способ. Логичным вариантом будет использовать feature matching — найти какие-то особые точки в обоих кадрах и выбрать сопоставления. Про то, как это делается, можно почитать здесь.

Про то, как это делается, можно почитать здесь.

2. Когда у нас есть два набора соответствующих друг другу точек, мы можем закинуть их в findFundamentalMat, чтобы получить фундаментальную матрицу, которая понадобится нам для stereoRectifyUncalibrated.

3. Запускаем stereoRectifyUncalibrated, получаем две матрицы для ректификации обоих кадров.

4. И… а дальше непонятно. Выпрямленные кадры у нас есть, но нет матрицы Q, которая была нужна для завершающего шага. Погуглив, я наткнулся примерно на такой же недоумения пост, и понял, что либо я что-то упустил в теории, либо в OpenCV этот момент не продумали.

OpenCV: мы — 2:0.

4.1 Меняем план

Но погодите. Возможно, мы с самого начала пошли не совсем правильным путем. В предыдущих попытках мы, по сути, пытались определить реальное положение трехмерных точек — отсюда необходимость знать параметры камеры, матрицы, ректифицировать кадры и так далее. По сути, это обычная триангуляция: на первой камере я вижу эту точку здесь, а на второй здесь — тогда нарисуем два луча, проходящих через центры камер, и их пересечение покажет, как далеко точка от нас находится.

Это все прекрасно, но вообще говоря, нам не нужно. Реальные размеры предметов интересовали бы нас, если бы наша модель использовалась потом для промышленных целей, в каких-нибудь 3d-принтерах. Но мы собираемся (эта цель слегка уже расплылась, правда) запихивать полученные данные в нейросети и им подобные классификаторы. Для этого нам достаточно знать только относительные размеры предметов. Они, как мы все еще помним, обратно пропорциональны смещениям параллакса — чем дальше от нас предмет, тем меньше смещается при нашем движении. Нельзя ли как-то найти эти смещения еще проще, просто каким-то образом сопоставив обе картинки?

Само собой, можно. Привет, оптический поток.

Это замечательный алгоритм, который делает ровно то, что нам нужно. Кладем в него картинку и набор точек. Потом кладем вторую картинку. Получаем на выходе для заданных точек их новое положение на второй картинке (приблизительное, само собой). Никаких калибровок и вообще никаких упоминаний о камере — оптический поток, несмотря на название, можно рассчитывать на базе чего угодно. Хотя обычно он все-таки используется для слежения за объектами, обнаружения столкновений и даже дополненной реальности.

Хотя обычно он все-таки используется для слежения за объектами, обнаружения столкновений и даже дополненной реальности.

Для наших целей мы (пока) хотим воспользоваться «плотным» потоком Гуннара Фарнебака, потому что он умеет рассчитывать поток не для каих-то отдельных точек, а для всей картинки сразу. Метод доступен с помощью calcOpticalFlowFarneback, и первые же результаты начинают очень-очень радовать — смотрите, насколько оно выглядит круче, чем предыдущий результат stereoRectifyUncalibrated + stereoBM.

Большое спасибо замечательной игре Portal 2 за возможность строить собственные комнаты и играть в кубики. I’m doin’ Science!

# encoding: utf-8

import cv2

import numpy as np

from matplotlib import pyplot as plt

img1 = cv2.imread('0.jpg', 0)

img2 = cv2.imread('1.jpg', 0)

def stereo_depth_map(img1, img2):

# 1: feature matching

orb = cv2.ORB()

kp1, des1 = orb.detectAndCompute(img1, None)

kp2, des2 = orb. detectAndCompute(img2, None)

bf = cv2.BFMatcher(cv2.NORM_HAMMING, crossCheck=True)

matches = bf.match(des1, des2)

matches = sorted(matches, key=lambda x: x.distance)

src_points = np.vstack([np.array(kp1[m.queryIdx].pt) for m in matches])

dst_points = np.vstack([np.array(kp2[m.trainIdx].pt) for m in matches])

# 2: findFundamentalMat

F, mask = cv2.findFundamentalMat(src_points, dst_points)

# 3: stereoRectifyUncalibrated

_, h2, h3 = cv2.stereoRectifyUncalibrated(src_points.reshape(src_points.shape[

0], 1, 2), dst_points.reshape(dst_points.shape[0], 1, 2), F, img1.shape)

rect1 = cv2.warpPerspective(img1, h2, (852, 480))

rect2 = cv2.warpPerspective(img2, h3, (852, 480))

# 3.5: stereoBM

stereo = cv2.StereoBM(cv2.STEREO_BM_BASIC_PRESET, ndisparities=16, SADWindowSize=15)

return stereo.compute(rect1, rect2)

def optical_flow_depth_map(img1, img2):

flow = cv2.calcOpticalFlowFarneback(img1, img2, 0.

detectAndCompute(img2, None)

bf = cv2.BFMatcher(cv2.NORM_HAMMING, crossCheck=True)

matches = bf.match(des1, des2)

matches = sorted(matches, key=lambda x: x.distance)

src_points = np.vstack([np.array(kp1[m.queryIdx].pt) for m in matches])

dst_points = np.vstack([np.array(kp2[m.trainIdx].pt) for m in matches])

# 2: findFundamentalMat

F, mask = cv2.findFundamentalMat(src_points, dst_points)

# 3: stereoRectifyUncalibrated

_, h2, h3 = cv2.stereoRectifyUncalibrated(src_points.reshape(src_points.shape[

0], 1, 2), dst_points.reshape(dst_points.shape[0], 1, 2), F, img1.shape)

rect1 = cv2.warpPerspective(img1, h2, (852, 480))

rect2 = cv2.warpPerspective(img2, h3, (852, 480))

# 3.5: stereoBM

stereo = cv2.StereoBM(cv2.STEREO_BM_BASIC_PRESET, ndisparities=16, SADWindowSize=15)

return stereo.compute(rect1, rect2)

def optical_flow_depth_map(img1, img2):

flow = cv2.calcOpticalFlowFarneback(img1, img2, 0. 5, 3, 20, 10, 5, 1.2, 0)

mag, ang = cv2.cartToPolar(flow[..., 0], flow[..., 1])

return mag

def plot(title, img, i):

plt.subplot(2, 2, i)

plt.title(title)

plt.imshow(img, 'gray')

plt.gca().get_xaxis().set_visible(False)

plt.gca().get_yaxis().set_visible(False)

plot(u'Первый кадр', img1, 1)

plot(u'Второй кадр (шаг вправо)', img2, 2)

plot(u'stereoRectifyUncalibrated', stereo_depth_map(img1, img2), 3)

plot(u'Первый кадр', optical_flow_depth_map(img1, img2), 4)

plt.show()

5, 3, 20, 10, 5, 1.2, 0)

mag, ang = cv2.cartToPolar(flow[..., 0], flow[..., 1])

return mag

def plot(title, img, i):

plt.subplot(2, 2, i)

plt.title(title)

plt.imshow(img, 'gray')

plt.gca().get_xaxis().set_visible(False)

plt.gca().get_yaxis().set_visible(False)

plot(u'Первый кадр', img1, 1)

plot(u'Второй кадр (шаг вправо)', img2, 2)

plot(u'stereoRectifyUncalibrated', stereo_depth_map(img1, img2), 3)

plot(u'Первый кадр', optical_flow_depth_map(img1, img2), 4)

plt.show()

Итак, отлично. Смещения у нас есть, и на вид неплохие. Как теперь нам получить из них координаты трехмерных точек?

4.2 Часть, в которой мы получаем координаты трехмерных точек

Эта картинка уже мелькала на одной из ссылок выше.

Расстояние до объекта здесь рассчитывается методом школьной геометрии (подобные треугольники), и выглядит так: . А координаты, соответственно, вот так: . Здесь w и h — ширина и высота картинки, они нам известны, f — фокусное расстояние камеры (расстояние от центра камеры до поверхности ее экрана), и B — камеры же шаг. Кстати, обратите внимание, что мы тут слегка нарушаем общепринятые названия осей, когда Z направлена вверх — у нас Z смотрит «вглубь» экрана, а X и Y — соответственно, направлены по ширине и высоте картинки.

Кстати, обратите внимание, что мы тут слегка нарушаем общепринятые названия осей, когда Z направлена вверх — у нас Z смотрит «вглубь» экрана, а X и Y — соответственно, направлены по ширине и высоте картинки.

Ну, насчет f все просто — мы уже оговаривали, что реальные параметры камеры нас не интересуют, лишь бы пропорции всех предметов изменялись по одному закону. Если подставить Z в формулу для X выше, то можно увидеть, что X от фокусного расстояния вообще не зависит (f сокращается), поэтому разные его значения буду менять только глубину — «вытягивать» или «сплющивать» нашу сцену. Визуально — не очень приятно, но опять же, для алгоритма классификации — совершенно все равно. Так что зададим фокусное расстояние интеллектуальным образом — просто придумаем. Я, правда, оставляю за собой право слегка изменить мнение дальше по тексту.

Насчет B чуть посложнее — если у нас нет встроенного шагомера, мы не знаем, на какую дистанцию переместилась камера в реальном мире. Так что давайте пока немного считерим и решим, что движение камеры происходит примерно плавно, кадров у нас много (пара десятков на секунду), и расстояние между двумя соседними примерно одинаковое, т. е. . И опять же, дальше мы слегка уточним эту ситуацию, но пока пусть будет так.

е. . И опять же, дальше мы слегка уточним эту ситуацию, но пока пусть будет так.

import cv2

import numpy as np

f = 300 # раз мы занимаемся визуализацией, фокус я все-таки подобрал так, чтобы сцена выглядела условно реальной

B = 1

w = 852

h = 480

img1 = cv2.imread('0.jpg', 0)

img2 = cv2.imread('1.jpg', 0)

flow = cv2.calcOpticalFlowFarneback(img1, img2, 0.5, 3, 20, 10, 5, 1.2, 0)

mag, ang = cv2.cartToPolar(flow[..., 0], flow[..., 1])

edges = cv2.Canny(img1, 100, 200)

result = []

for y in xrange(img1.shape[0]):

for x in xrange(img1.shape[1]):

if edges[y, x] == 0:

continue

delta = mag[y, x]

if delta == 0:

continue

Z = (B * f) / delta

X = (Z * (x - w / 2.)) / f

Y = (Z * (y - h / 2.)) / f

point = np.array([X, Y, Z])

result.append(point)

result = np.vstack(result)

def dump2ply(points):

# сохраняем в формат .ply, чтобы потом открыть Блендером

with open('points. ply', 'w') as f:

f.write('ply\n')

f.write('format ascii 1.0\n')

f.write('element vertex {}\n'.format(len(points)))

f.write('property float x\n')

f.write('property float y\n')

f.write('property float z\n')

f.write('end_header\n')

for point in points:

f.write('{:.2f} {:.2f} {:.2f}\n'.format(point[0], point[2], point[1]))

dump2ply(result)

ply', 'w') as f:

f.write('ply\n')

f.write('format ascii 1.0\n')

f.write('element vertex {}\n'.format(len(points)))

f.write('property float x\n')

f.write('property float y\n')

f.write('property float z\n')

f.write('end_header\n')

for point in points:

f.write('{:.2f} {:.2f} {:.2f}\n'.format(point[0], point[2], point[1]))

dump2ply(result)

Вот так выглядит результат. Надеюсь, эта гифка успела загрузиться, пока вы дочитали до этого места.

Для наглядности я взял не все точки подряд, а только границы, выделенные Canny-детектором

С первого взгляда (во всяком случае, мне) все показалось отличным — даже углы между гранями кубиков образовали симпатичные девяносто градусов. С предметами на заднем плане получилось похуже (обратите внимание, как исказились контуры стен и двери), но хэй, наверное, это просто небольшой шум, его можно будет вылечить использованием большего количества кадров или чем-нибудь еще.

Из всех возможных поспешных выводов, которые можно было здесь сделать, этот оказался дальше всех от истины.

В общем, основная проблема оказалась в том, что какая-то часть точек довольно сильно искажалась. И — тревожный знак, где уже пора было заподозрить неладное — искажалась не случайным образом, а примерно в одних и тех же местах, так что исправить проблему путем последовательного наложения новых точек (из других кадров) не получалось.Выглядело это примерно так:

Лестница сминается, местами превращаясь в аморфный кусок непонятно-чего.

Я очень долго пытался это починить, и за это время перепробовал следующее:

— сглаживать каринку с оптическим потоком: размытие по Гауссу, медианный фильтр и модный билатеральный фильтр, который оставляет четкими края. Бесполезно: предметы наоборот, еще сильнее расплывались.

— пытался находить на картинке прямые линии с помощью Hough transform и переносить их в неизменном прямом состоянии. Частично работало, но только на границах — поверхности по-прежнему оставались такими же искаженными; плюс никуда не получалось деть мысль в духе «а что если прямых линий на картинке вообще нет».

— я даже попытался сделать свою собственную версию оптического потока, пользуясь OpenCVшным templateMatching. Работало примерно так: для любой точки строим вокруг нее небольшой (примерно 10×10) квадрат, и начинаем двигать его вокруг и искать максимальное совпадение (если известно направление движения, то «вокруг» можно ограничить). Получилось местами неплохо (хотя работало оно явно медленнее оригинальной версии):

Слева уже знакомый поток Фарнебака, справа вышеописаный велосипед

С точки зрения шума, увы, оказалось ничуть не лучше.

В общем, все было плохо, но очень логично. Потому что так оно и должно было быть.

Иллюстрация к проблеме. Движение здесь — по-прежнему шаг вправо

Давайте выберем какую-нибудь зеленую точку из картинки выше. Предположим, мы знаем направление движения, и собираемся искать «смещенного близнеца» нашей зеленой точки, двигаясь в заданном направлении. Когда мы решаем, что нашли искомого близнеца? Когда наткнемся на какой-нибудь «ориентир», характерный участок, который похож на окружение нашей начальной точки. Например, на угол. Углы в этом отношении легко отслеживать, потому что они сами по себе встречаются довольно редко. Поэтому если наша зеленая точка представляет собой угол, и мы находим похожий угол в заданной окрестности, то задача решена.

Например, на угол. Углы в этом отношении легко отслеживать, потому что они сами по себе встречаются довольно редко. Поэтому если наша зеленая точка представляет собой угол, и мы находим похожий угол в заданной окрестности, то задача решена.

Чуть сложнее, но все еще легко обстоит ситуация с вертикальной линией (вторая левая зеленая точка). Учитывая, что мы двигаемся вправо, вертикальная линия встретится нам только один раз за весь период поиска. Представьте, что мы ползем своим поисковым окном по картинке и видим однотонный фон, фон, снова фон, вертикальный отрезок, опять фон, фон, и снова фон. Тоже несложно.

Проблема появляется, когда мы пытаемся отслеживать кусок линии, расположенной параллельно движению. У красной точки нет одного четко выраженного кандидата на роль смещенного близнеца. Их много, все они находятся рядом, и выбрать какого-то одного тем методом, что мы пользуемся, просто невозможно. Это функциональное ограничение оптического потока. Как нас любезно предупреждает википедия в соответствующей статье, «We cannot solve this one equation with two unknown variables», и тут уже ничего не сделаешь.

Вообще, если честно, то это, наверное, не совсем правда. Вы ведь можете найти на правой картинке соответствие красной точке? Это тоже не очень сложно, но для этого мы мысленно пользуемся каким-то другим методом — находим рядом ближайшую «зеленую точку» (нижний угол), оцениваем расстояние до нее и откладываем соответствующее расстояние на второй грани куба. Алгоритмам оптического потока есть куда расти — этот способ можно было бы и взять на вооружение (если этого еще не успели сделать).

На самом деле, как подсказывает к этому моменту запоздавший здравый смысл, мы все еще пытаемся сделать лишнюю работу, которая не важна для нашей конечной цели — распознавания, классификации и прочего интеллекта. Зачем мы пытаемся запихать в трехмерный мир все точки картинки? Даже когда мы работаем с двумерными изображениями, мы обычно не пытаемся использовать для классификации каждый пиксель — большая их часть не несет никакой полезной информации.

Почему бы не делать то же самое и здесь?

Почему бы не делать то же самое и здесь?Собственно, все оказалось вот так просто. Мы будем рассчитывать тот же самый оптический поток, но только для «зеленых», устойчивых точек. И кстати, в OpenCV о нас уже позаботились. Нужная нам штука называется поток Лукаса-Канаде.

Приводить код и примеры для тех же самых случаев будет слегка скучно, потому что получится то же самое, но с гораздо меньшим числом точек. Давайте по дороге сделаем еще чего-нибудь: например, добавим нашему алгоритму возможность обрабатывать повороты камеры. До этого мы двигались исключительно вбок, что в реальном мире за пределами окон поездов встречается довольно редко.

С появлением поворотов координаты X и Z у нас смешиваются. Оставим старые формулы для расчета координат относительно камеры, и будем переводить их в абсолютные координаты следующим образом (здесь — координаты положения камеры, альфа — угол поворота):

(игрек — читер; это потому, что мы считаем, что камера не двигается вверх-вниз)

Где-то здесь же у нас появляются проблемы с фокусным расстоянием — помните, мы решили задать его произвольным? Так вот, теперь, когда у нас появилась возможность оценивать одну и ту же точку с разных углов, он начал иметь значение — именно за счет того, что координаты X и Z начали мешаться друг с другом. На самом деле, если мы запустим код, аналогичный предыдущему, с произвольным фокусом, мы увидим примерно вот что:

На самом деле, если мы запустим код, аналогичный предыдущему, с произвольным фокусом, мы увидим примерно вот что:

Неочевидно, но это попытка устроить обход камеры вокруг обычного кубика. Каждый кадр — оценка видимых точек после очередного поворота камеры. Вид сверху, как на миникарте.

К счастью, у нас все еще есть оптический поток. При повороте мы можем увидеть, какие точки переходят в какие, и рассчитать для них координаты с двух углов зрения. Отсюда несложно получить фокусное расстояние (просто возьмите две вышеприведенных формулы для разных значений альфа, приравняйте координаты и выразите f). Так гораздо лучше:

Не то что бы все точки легли идеально одна в другую, но можно хотя бы догадаться о том, что это кубик.

И, наконец, нам нужно как-то справляться с шумом, благодаря которому наши оценки положения точек не всегда совпадают (видите на гифке сверху аккуратные неровные колечки? вместо каждого из них, в идеале, должна быть одна точка). Тут уже простор для творчества, но наиболее адекватный способ мне показался таким:

Тут уже простор для творчества, но наиболее адекватный способ мне показался таким:

— когда у нас есть подряд несколько сдвигов в сторону, объединяем информацию с них вместе — так для одной точки у нас будет сразу несколько оценок глубины;

— когда камера поворачивается, мы пытаемся совместить два набора точек (до поворота и после) и подогнать один к другому. Эта подгонка по-правильному называется «регистрацией точек» (о чем вы бы никогда не догадались, услышав термин в отрыве от контекста), и для нее я воспользовался алгоритмом Iterative closest point, нагуглив версию для питона + OpenCV;

— потом точки, которые лежат в пределах порогового радиуса (определяем методом ближайшего соседа), сливаются вместе. Для каждой точки мы еще отслеживаем что-то типа «интенсивности» — счетчик того, как часто она объединялась с другими точками. Чем больше интенсивность — тем больше шанс на то, что это честная и правильная точка.

Результат может и не такой цельный, как в случае с кубиками из Портала, но по крайней мере, точный. Вот пара воссозданных моделей, которые я сначала загрузил в Блендер, покрутил вокруг них камеру и сохранил полученные кадры:

Вот пара воссозданных моделей, которые я сначала загрузил в Блендер, покрутил вокруг них камеру и сохранил полученные кадры:

Голова профессора Доуэля

Какая-то рандомная машина

Бинго! Дальше нужно их все запихать в распознающий алгоритм и посмотреть, что получится. Но это, пожалуй, оставим на следующую серию.

Слегка оглянемся назад и вспомним, зачем мы это все делали. Ход рассуждений был такой:

— нам нужно уметь распознавать вещи, изображенные на картинках

— но эти картинки каждый раз, когда мы меняем положение или смотрим на одну и ту же вещь с разных углов, меняются. Иногда до неузнаваемости

— это не баг, а фича: следствие того, что наши ограниченые сенсоры глаз видят только часть предмета, а не весь предмет целиком

— следовательно, нужно как-то объединить эти частичные данные от сенсоров и собрать из них представление о предмете в его полноценной форме.

Вообще говоря, это ведь наверняка проблема не только зрения. Это скорее правило, а не исключение — наши сенсоры не всемогущи, они постоянно воспринимают информацию об объекте частями — но любопытно, насколько все подобные случаи можно объединить в какой-то общий фреймворк? Скажем (возвращаясь к зрению), ваши глаза сейчас постоянно совершают мелкие и очень быстрые движения — саккады — перескакивая между предметами в поле зрения (а в промежутках между этими движениями ваше зрение вообще не работает — именно поэтому нельзя увидеть собственные саккады, даже уставившись в зеркало в упор). Мозг постоянно занимается упорной работой по «сшиванию» увиденных кусочков. Это — та же самая задача, которую мы только что пытались решить, или все-таки другая? Восприятие речи, когда мы можем соотнести десяток разных вариантов произношения слова с одним его «идеальным» написанием — это тоже похожая задача? А как насчет сведения синонимов к одному «образу» предмета?

Это скорее правило, а не исключение — наши сенсоры не всемогущи, они постоянно воспринимают информацию об объекте частями — но любопытно, насколько все подобные случаи можно объединить в какой-то общий фреймворк? Скажем (возвращаясь к зрению), ваши глаза сейчас постоянно совершают мелкие и очень быстрые движения — саккады — перескакивая между предметами в поле зрения (а в промежутках между этими движениями ваше зрение вообще не работает — именно поэтому нельзя увидеть собственные саккады, даже уставившись в зеркало в упор). Мозг постоянно занимается упорной работой по «сшиванию» увиденных кусочков. Это — та же самая задача, которую мы только что пытались решить, или все-таки другая? Восприятие речи, когда мы можем соотнести десяток разных вариантов произношения слова с одним его «идеальным» написанием — это тоже похожая задача? А как насчет сведения синонимов к одному «образу» предмета?

Если да — то возможно, проблема несколько больше, чем просто местечковый алгоритм зрительной системы, заменяющий нашим недоэволюционировавшим глазам лазерную указку сканера.

Очевидные соображения говорят, что когда мы пытаемся воссоздать какую-то штуку, увиденную в природе, нет смысла слепо копировать все ее составные части. Чтобы летать по воздуху, не нужны машущие крылья и перья, достаточно жесткого крыла и подъемной силы; чтобы быстро бегать, не нужны механические ноги — колесо справится гораздо лучше. Вместо того, чтобы копировать увиденное, мы хотим найти принцип и повторить его своими силами (может быть, сделав это проще/эффективней). В чем состоит принцип интеллекта, аналог законов аэродинамики для полета, мы пока не знаем. Deep learning и Ян Лекун, пророк его (и вслед за ним много других людей) считают, что нужно смотреть в сторону способности строить «глубокие» иерархии фич из получаемых данных. Может быть, мы сможем добавить к этому еще одно уточнение — способность объединять вместе релевантные куски данных, воспринимая их как части одного объекта и размещая в новом измерении?

Распознавание изображений для бизнеса

Распознавание изображений используется в бизнесе для:– анализа видео и снимков камер наблюдения (например, для распознавания клиентов, фиксации краж в магазине)

– классификации отсканированных документов и извлечения данных из них

– мониторинга социальных сетей (анализа эффективности маркетинговых акций, анализа конкурентов)

– распознавания одежды и аксессуаров на фотках (для электронной коммерции)

– автоматического контроля сотрудников по скриншотам экрана компьютера

Примеры использования распознавания изображений для бизнеса приведены ниже.

27.10.20. Microsoft Azure AI теперь описывает изображения так же хорошо, как и люди

Новая модель нейросети для генерации описаний к изображениям теперь доступна потребителям через Computer Vision в Azure Cognitive Services, которое является частью Azure AI, и позволяет разработчикам использовать эту возможность для улучшения доступности своих сервисов. Согласно результатам исследования, при оценке на тестах nocaps система ИИ создавала более содержательные и точные описания, чем это делали люди для тех же изображений. Новая модель уже используется в приложение Seeing AI и в конце этого года начнет работать в Microsoft Word и Outlook для Windows и Mac, а также в PowerPoint для Windows, Mac и в веб-версии. Автоматическое описание помогает пользователям получить доступ к важному содержимому любого изображения, будь то фотография, возвращенная в результатах поиска, или иллюстрация для презентации.

2020. Cisco купила разработчика ПО для автоматического распознавания картинки с камер видеонаблюдения

Cisco купила стартап Modcam, который разрабатывает ПО для автоматического распознавания картинки с камер видеонаблюдения. Предполагается, что активы купленного стартапа дополнят ассортимент смарт-камер Meraki, которым обладает Cisco. Технологии Modcam могут использоваться в системах видеонаблюдения для точного определения местоположения объектов и определения маршрута движения. Возможности интеллектуальных камер Cisco Meraki со своей стороны включают распознавание движений и объектов. Однако аналитика в рамках этого оборудования ограничивается лишь одной камерой.

Предполагается, что активы купленного стартапа дополнят ассортимент смарт-камер Meraki, которым обладает Cisco. Технологии Modcam могут использоваться в системах видеонаблюдения для точного определения местоположения объектов и определения маршрута движения. Возможности интеллектуальных камер Cisco Meraki со своей стороны включают распознавание движений и объектов. Однако аналитика в рамках этого оборудования ограничивается лишь одной камерой.

2020. Facebook представила ИИ-инструмент для распознавания товаров на фотографиях

Facebook запустила инструмент GrokNet, который может определять разные категории товаров на фотографии с помощью технологий искусственного интеллекта. Он распознаёт десятки тысяч разных атрибутов, например, бренды, цвета, размер. Этот инструмент уже интегрирован в торговую площадку Facebook Marketplace — с его помощью пользователи могут быстро создавать описание товара (сервис пока не доступен в России). Например, когда продавец загружает фотографию своего дивана, сайт предлагает указать характеристики «чёрный», «кожа», «секционный диван». ИИ-система «училась» распознавать изображения на базе, которая включает около 100 млн пользовательских фотографий в Marketplace.

ИИ-система «училась» распознавать изображения на базе, которая включает около 100 млн пользовательских фотографий в Marketplace.

2020. В СБИС появилось ИИ-распознавание первичных документов

В бухгалтерском модуле системы управления бизнесом СБИС появилась функция автоматического ввода/распознавания первичных документов. Она работает на технологии машинного обучения и позволяет распознавать товарные накладные (ТОРГ-12), УПД, счета-фактуры и авансовые отчеты. Достаточно отсканировать документ или сфотографировать с помощью смартфона и добавить картинку в систему. Она сама добавит документ в базу и извлечет из него данные (контагентов, номенклатуру товаров, затраты…). Разработчики обещают высокую точность распознавания даже на нечетких снимках. Многостраничные документы – тоже поддерживаются.

2019. Яндекс запустил сервис для распознавания лиц и изображений

В арсенале платформы Яндекс.Облако появился сервис Yandex Vision для анализа изображений при помощи машинного обучения. Например, при помощи сервиса компании могут распознавать тексты архивов и искать по ним данные, переводить тексты с изображений и модерировать контент пользователей. Бизнесу Yandex Vision может пригодиться для сканирования однотипных документов и занесения их в систему документооборота, например, по ключевым словам. Сервис также ищет лица людей на изображении и выделяет их прямоугольниками, но пока не распознает — с помощью этой функции нельзя находить похожие лица или идентифицировать личность. Яндекс уже определился с ценами на распознавания текста: 120 руб за 1000 картинок в месяц. Обнаружение лиц – пока бесплатно. Подобный сервис уже предоставляют Mail.ru и FindFace.

Например, при помощи сервиса компании могут распознавать тексты архивов и искать по ним данные, переводить тексты с изображений и модерировать контент пользователей. Бизнесу Yandex Vision может пригодиться для сканирования однотипных документов и занесения их в систему документооборота, например, по ключевым словам. Сервис также ищет лица людей на изображении и выделяет их прямоугольниками, но пока не распознает — с помощью этой функции нельзя находить похожие лица или идентифицировать личность. Яндекс уже определился с ценами на распознавания текста: 120 руб за 1000 картинок в месяц. Обнаружение лиц – пока бесплатно. Подобный сервис уже предоставляют Mail.ru и FindFace.

2017. Adobe представил свой искусственный интеллект – Sensei

Флагманские продукты компании Adobe – Photoshop и Premiere – предназначены для обработки изображений и видео. Это огромное поле работы для искусственного интеллекта. И такой интеллект появился – Adobe Sensei. Только представьте, что можно будет автоматически вырезать объект из фотографии или видео, или наложить фантастические эффекты. Кроме работы с графикой, Sensei будет использоваться для поиска и разметки изображений в Adobe Creative Cloud, для распознавания текста на фотографиях в Adobe Document Cloud и для предиктивной аналитики в системе управления маркетингом Adobe Marketing Cloud.

Кроме работы с графикой, Sensei будет использоваться для поиска и разметки изображений в Adobe Creative Cloud, для распознавания текста на фотографиях в Adobe Document Cloud и для предиктивной аналитики в системе управления маркетингом Adobe Marketing Cloud.

2015. Нейросеть Microsoft победила Google и Intel в конкурсе на распознавание изображений

Программа, разработанная командой Microsoft Research под руководством Цзянь Сана (на фото) показала лучший результат на шестом конкурсе по распознаванию изображений ImageNet. Ей удалось превзойти конкурентные системы от Google, Intel, Qualcomm и Tencent, а также ряда стартапов. Система компьютерного зрения Microsoft представляет собой очень глубокую нейросеть из 150 слоев, которую обучали с применением фреймворка глубокого остаточного обучения. Microsoft уже использует компьютерное зрение в своих продуктах: игровом сенсоре Kinect и системе распознавания лиц Windows Hello.

2015. Стартап Deepomatic получил $1. 4 млн на распознавание одежды на картинках

4 млн на распознавание одежды на картинках

Французский стартап Deepomatic получил $1.4 млн инвестиций от Alven Capital и нескольких бизнес-ангелов на развитие своей технологии компьютерного зрения, которая специализирована на распознавании элементов одежды. Идея в том, чтобы дополнять картинки с модной одеждой e-commerce ссылками. Например, вам понравились туфельки на девушке, изображенной на картинке – вы кликаете и попадаете на страничку интернет-магазина, где продаются эти туфли.

2015. Искусственный интеллект Baidu побил рекорд Google в распознавании изображений

Китайскаий интернет-гигант Baidu создал суперкомпьютер Minwa, который (по словам разработчиков) сумел превзойти рекорд компании Google по качеству распознавания изображений. Суперкомпьютер показал точность 95,42%, по сравнению с результатом 95,2%, показанным искусственным интеллектом Гугла. Minwa имеет 72 мощных центральных процессоров и 144 графических процессоров. В компьютере запрограммирована нейронная сеть, способная не только выполнить распознавание объектов на изображениях с высокой разрешающей способностью, но и самообучаться, что позволяет системе выявлять характерные особенности каждого из отдельных объектов. Таким образом, система может распознать изображение, представленное в любой форме, даже когда оно повернуто на некоторый угол и сфотографировано снова.

Таким образом, система может распознать изображение, представленное в любой форме, даже когда оно повернуто на некоторый угол и сфотографировано снова.

2014. Google создал алгоритм для создания подписей к изображениям на естественном языке

Разработчики из подразделения Google Research создали алгоритм обучения нейросети для автоматической генерации текстового описания объектов на изображениях на естественном (английском) языке. Он сочетает в себе алгоритмы компьютерного зрения и обработки естественного языка. К примеру, система способна создавать подписи наподобие «две собаки играют на траве» или «маленькая девочка в розовой шляпке надувает пузыри». Идея пришла благодаря последним достижениям в машинном переводе, где одна рекуррентная нейронная сеть (RNN) преобразует предложение на одном языке в векторную модель, а вторая – преобразует эту модель в предложение на другом языке. Вот инженеры и подумали, почему бы в качестве первой нейросети не использовать сверточную нейросеть для распознавания объектов на изображениях (CNN). Разработчики планируют использовать полученную систему, например, для помощи слепым людям и для усовершенствования поиска картинок на Google Images.

Разработчики планируют использовать полученную систему, например, для помощи слепым людям и для усовершенствования поиска картинок на Google Images.

2013. Cortica получил $1.5 млн от Mail.Ru на развитие технологии распознавания изображений

Израильский стартап Cortica получил $1.5 млн инвестиций от Mail.Ru для развития своей технологии распознавания изображений. Разработчики говорят, что их технология симулирует человеческий кортекс мозга (отсюда и название) и способна распознавать изображения с такой же высокой точностью, как человек. Для Mail.ru эта технология интересна прежде всего для таргетирования рекламы по картинкам, которые просматривают пользователи в социальных сетях (VK, Одноклассники).

2013. Google купил стартап DNNresearch – победителя конкурса распознавания изображений

Google купил канадский стартап DNNresearch, который в 2012 с большим перевесом выиграл конкурс ImageNet (в котором нейросети соревнуются в точности распознавания изображений). DNNresearch состоит всего из 3 человек – профессора Университета Торонто – Джорджа Хинтона (на фото) и его двух студентов. Ранее Гугл предоставлял Хинтону грант в размере $600K на его исследования в сфере компьютерного зрения. Для Гугла эта технология очень важна для улучшения поиска по картинкам в Google Images и по фоткам в Google Photos.

DNNresearch состоит всего из 3 человек – профессора Университета Торонто – Джорджа Хинтона (на фото) и его двух студентов. Ранее Гугл предоставлял Хинтону грант в размере $600K на его исследования в сфере компьютерного зрения. Для Гугла эта технология очень важна для улучшения поиска по картинкам в Google Images и по фоткам в Google Photos.

Академия 1С:Документооборот | Лушников и партнеры: Распознавание изображений на сервере 1С:Документооборот 8

Каким образом работает распознавание картинок в 1С:Документооборот?

В статье “Извлечение текстов в 1С:Документооборот” сказано, что 1С:Документооборот 8 умеет извлекать тексты из популярных офисных форматов файлов и использовать эту информацию для полнотекстового поиска по содержимому файлов. А вот если в СЭД помещен файл графического формата, то как получить распознанный текст из картинки? В данной статье пойдет речь о том, какие надо установить дополнительные программы на сервер 1С, чтобы работало автоматическое распознавание сканов файлов.

Настройка распознавания изображений в 1С:Документооборот в клиент-серверном варианте на живых примерах подробно рассмотрена в видео-курсе, заказать который можно по ссылке http://video.doc-lvv.ru/

Работа сканирования и распознавания в 1С:Документооборот 8 возможна только под Windows.

Чтобы настроить распознавание изображений на сервере нужно:

1. Установить программы CuneiForm, ImageMagic и Ghostscript.

2. Задать в настройках программы параметры распознавания и указать путь к программе ImageMagic.

Общая схема работы сканирования и распознавания указана на следующем рисунке.

Установку программы CuneiForm в файл-серверном варианте следует делать на компьютере пользователя под тем пользователем, который в дальнейшем будет с ней работать, а в клиент-серверном варианте на сервере 1С – под пользователем, под которым работает сервис 1С:Предприятия.

Установка CuneiForm

Программа CuneiForm нужна для распознавания графических файлов.

Находим в дистрибутиве cuneiform файл setup.exe. Запускаем его и устанавливаем.

Открываем 1С:Документооборот под Администратором. Переходим в настройки программы и устанавливаем флаг «Распознавание изображений с помощью CuneiForm».

Загрузим любую картинку с текстом.

Откроем ее на просмотр и убедимся, что там есть текст.

После отработки регламентного задания «Распознавание» увидим распознанный текст в текстовом образе.

Откроем теперь тестовый образ из карточки файла.

В текстовом образе карточки файла 1С:Документооборот будет находиться распознанный текст из картинки.

Установка Ghostscript

Программа Ghostscript нужна программе ImageMagic для преобразования графических файлов в формат pdf и обратно.

Находим в дистрибутиве Ghostscript файл gs901w32.exe. Запускаем его.

Нажимаем кнопку Setup.

Указываем путь установки и нажимаем кнопку Install.

Программа установлена.

Установка ImageMagic

Программа ImageMagic нужна для преобразования графических файлов в формат pdf и обратно.

Находим в дистрибутиве ImageMagic файл ImageMagick-6.9.1-6-Q8-x86-dll.exe. Запускаем его.

Нажимаем кнопку Next.

Соглашаемся с условиями лицензионного соглашения.

Читаем полезную информацию.

Указываем путь установки.

Указываем название папки стартового меню.

Указываем компоненты, которые надо установить.

Подтверждаем установку. Нажимаем кнопку Install.

Читаем полезную информацию.

Программа установлена. Нажимаем кнопку Finish.

Теперь, чтобы на сервере 1С происходило преобразование отсканированных pdf-файлов в графические файлы с последующим распознаванием нам надо указать общие настройки распознавания.

В программе 1С:Документооборот в настройках программы нажимаем на кнопку «Настройки распознавания», включаем использование ImageMagick и указываем путь к программе.

Далее загрузим в папку файлов многостраничный pdf.

После того, как отработает регламентное задание «Распознавание» мы в текстовом образе увидим распознанный текст.

Интеллект в интернет-технологиях. Распознавание изображений,…

Привет, Вы узнаете про интеллект в интернет-технологиях распознавание изображений речи смысла, Разберем основные ее виды и особенности использования. Еще будет много подробных примеров и описаний. Для того чтобы лучше понимать что такое интеллект в интернет-технологиях распознавание изображений речи смысла , настоятельно рекомендую прочитать все из категории Распознавание образов

. Об этом говорит сайт https://intellect.icuИнтернет с каждым днем все больше напоминает самоорганизованный универсум, что эволюционирует с огромной скоростью. И хотя эта система еще не имеет полноценного искусственного интеллекта, зачатки его создания уже начинают появляться (например, виртуальный собеседник инф или Акинатор, который читает мысли, машинное зрение и голосовой интерфейс поисковых систем). В день, когда тест Тьюринга будет пройден и Интернет по функциональному инструмента превратится в незаменимого помощника, а для кого-то другая.

В день, когда тест Тьюринга будет пройден и Интернет по функциональному инструмента превратится в незаменимого помощника, а для кого-то другая.

Кто стоит за всем этим? Безусловно, это сообщества людей.Сообщества, объединенные общими идеями, целями и интересами, которые готовы тратить свое время и ресурсы на осуществление этих идей. Поэтому, с каждым днем в Интернете появляется все больше разумных программ, их функционал становится все шире, а посетители превращаются из потребителей в активных создателей контента.

Виртуальный собеседник (бот-консультант) – это специалист технической поддержки, который доступен круглосуточно и мгновенно отвечает на вопросы пользователей. Он общается на естественном языке. Он может не только помочь что-то найти на сайте, но и предложить полезную для пользователя информацию или товар.Бот сохраняет заданные ему вопросы.Благодаря этому владелец сайта может узнать, что ищут на сайте, чего не хватает, что можно улучшить, какая аудитория клиентов.

Бот является встроенным модулем. Для просмотра модуль бота нужно вставить короткий специальный код на необходимые страницы сайта.Консультант может иметь стандартное оформление. Но он также может быть оформлен как индивидуальный персонаж для конкретного сайта.

Бота нужно научить отвечать на вопросы посетителей. Начальное обучение производится на основании первоначального словаря. В дальнейшем, анализируя диалоги клиентов и бота, владелец сайта может продолжить обучение самостоятельно.

Все шаги по настройке бота, размещение его базы знаний , сбора диалогов и т.д., компания разработчик делает самостоятельно. В случае каких-либо вопросов или необходимых доработок – компания-разработчик поддерживает работу Бота-консультанта.

Продукты компании «Наносемантика»

http://www.nanosemantics.ru/

«Наносемантика» – лидер российского рынка технологий искусственного интеллекта, нацеленных на решение бизнес-задач. Компания с 2005 года занимается разработкой Инфив – виртуальных собеседников, управляемых искусственным интеллектом. «Наносемантика» развивает технологии и онлайн-сервисы, в основе которых лежит прямой диалог машины с пользователем.

«Наносемантика» развивает технологии и онлайн-сервисы, в основе которых лежит прямой диалог машины с пользователем.

- WebMoney

- Beeline Казахстан

- Эlixir банк

- Банк «Тинькофф Кредитные Системы»

- NETBYNET Холдинг

- «А-а-яй.ру»

ρБот-консультант для круглосуточной поддержки клиентов на сайте

http://chatbot.tw1.ru/business.htm

Консультант, который способен работать 24 часа в сутки 7 дней в неделю без отдыха и перерывов на обед – мечта для сервисных компаний с большим количеством клиентов, которые задают одинаковые вопросы.

Первопроходцем была небольшая канадская компания Tineye, второй – Google, а третьей – китайский поисковик Baidoo. Яндекс стал четвертым игроком и надеется, что за ними подтянется Microsoft. Впрочем, в Tineye очень небольшая база картинок (3500000000), а в Baidoo сильный перекос в китайский рынок. Для украинского пользователя уместным будет использование поиска в Яндексе и Google: их база изображений составляет десятки миллиардов изображений.

Картинку на сервис можно загрузить одним из трех способов:

- Ввести URL-адрес картинки и нажать на кнопку «Найти». Этот способ подойдет для поиска картинки, для которой известно ее адрес в Интернете.

- Скачать картинку со своего компьютера.

- Перетащить картинку с помощью мыши в указанное окно.

Зачем нужен сервис поиска похожей картинки?

- Для дизайнеров, художников иногда важно найти похожую картинку или фото, но в другом ракурсе.

- Сервис поможет найти сайт или Интернет-магазин, где можно найти или приобрести вещь, которая изображена на картинке.

- Для поиска информации о некотором человеке, животном или архитектурном сооружении.

Картинка, по которой ищут подобные изображения должна соответствовать следующим требованиям:

- Формат картинки – jpeg, gif, png,

- Размер картинки не более 8 Мб.

Сервис поиска изображений используют алгоритмы анализа и классификации данных, а для поиска изображений по визуальному содержанию применяются технологии компьютерного зрения и описания содержания изображений. Данная технология превращает загруженную картинку в набор «визуальных слов». После этого система среди миллиардов картинок, которые содержатся в ее базе данных выбирает изображение, имеющие сходные «визуальные слова» и выдает их пользователю. При этом поиск займет не более минуты.

Данная технология превращает загруженную картинку в набор «визуальных слов». После этого система среди миллиардов картинок, которые содержатся в ее базе данных выбирает изображение, имеющие сходные «визуальные слова» и выдает их пользователю. При этом поиск займет не более минуты.

Задачи, которые решает группа компьютерного зрения:

- Классификация изображений.

- Поиск дубликатов и похожих изображений.

- Распознавания текста.

- Понимание сцены и распознавания объектов на изображениях.

В таком сервиса есть несколько сценариев использования:

- Поиск такой же картинки, но другой: высшего качества, большого размера, без водяного знака или, наоборот, фотожабы с ней.

- Узнать, кто находится на картинке, то есть определить изображение человека с текстовыми описаниями на сайтах.

- Отражать не картинки, а сайты, где они размещены. Например, по фотографии дизайнерского стула, дизнаетися, где его можно купить.

Компьютерное зрение

Александр Крайнов, менеджер проектов компьютерного зрения

Разработчики Яндекса разработали собственный алгоритм, который сильно отличается от аналогов. Использована Яндексом технология компьютерного зрения называется Content Based Image Retrieval (CBIR) и внутри компании носит название «Сибирь».

Опираясь на обобщенные пределы объектов, контрастные области и другие ключевые элементы картинки, робот создает свою библиотеку изображений, подобно как обычный поисковик скачивает упрощенные текстовые версии веб-страниц при индексировании, и уже по ней ведет поиск. Способность к обобщению уже показывает поиск: иногда находится не просто такая же картинка, а другое изображение, содержащее такой же объект.

Этот алгоритм лучше всего работает с URL-адресом картинки, а не загруженной с компьютера. То есть, когда исходная картинка размещена в Интернете, а не на компьютере пользователя. Поскольку поисковая база очертания предметов формируется изображений, которые уже проиндексированы системой, поэтому, если изображение отсутствует в поисковой базе, хорошего результата не будет.

В отличие от сервиса Google, который различает цвета, новый алгоритм Яндекса не различает цвета, но способен анализировать очертания предметов. После проведенного анализа формируется поисковый запрос для стандартного (словесного) поиска по изображениям. Исключение составляют торговые марки и шрифты – популярные логотипы, как правило, программа распознает. То же самое относится и к памятникам и архитектурных изображений. Поэтому, поиск архитектурного памятника по загруженной картинкой (фотографией) будет успешнее, чем поиск по фотографии домашнего праздника.

Стоит отметить, что поиск по картинкам от Google тоже часто работает некорректно – в результатах часто демонстрируются различные изображения с похожей цветовой гаммой. Впрочем, понятно, что данное направление только начинает развиваться. Яндекс пошел своим путем, не отставая при этом от других конкурентов. Дальнейшие разработки Яндекс продвигаются в том же направлении, что и Google, внедрил технологию Goggles в мобильный поиск. Google Goggles позволяют искать в реальном времени по изображению, которая берется из камеры смартфона.

Google Goggles позволяют искать в реальном времени по изображению, которая берется из камеры смартфона.

Благодаря Голосовом интерфейса можно диктовать запросы в клиентской программе на устройстве, а не вводить их. Чтобы транскрибировать продиктованы слова в написанный текст, Google направляет выражения серверы, где используется технология распознавания шаблонов .

Для того, научить систему лучше распознавать правильные поисковые запросы, Google сохраняет высказывания, чтобы улучшать службы, в частности: данные о языке, страну, выражение и предположения системы о сказанном. Сохранены аудиоданные не содержат идентификатор учетной записи Google, если пользователь этого не указал.

Для каждого языка Голосовой интерфейс Google собирает голосовые фрагменты, которые позволяют создать модели языка, которые обеспечивают корректную работу сервисов. Google имеет базу аудио образов, произносятся носителями языка, отличаются акцентами, возрасту и индивидуальным особенностям, произносить часто употребляемые фразы в различных акустических условиях, например, в ресторане, на улице или в машине. Для каждого языка Google создает словарь, содержащий более миллиона распознанных слов.

Для каждого языка Google создает словарь, содержащий более миллиона распознанных слов.

Сервис работает на основе системы Speech Input API, благодаря которой и реализуется голосовое управление Интернет-браузером. Сервис сейчас воплощено в Google Поиск, Google Переводчик , Cmail, Google Docs.

Голосовой поиск Google

Voice Search – это расширение для Google Chrome, который позволяет осуществлять поиск или иные действия в Интернете с помощью своего голоса. На странице Google в строке поиска изображено иконку микрофона. Пользователь должен нажать на него и произнести громко и четко фразу или слово. Для получения озвученных ответов нужно использовать язык в соответствии с речевого интерфейса Google Chrome.

В случае запроса о заметных или общепризнанные объекты будет озвучена информация, которая берется из «Графа знаний» Google – базы, содержащей информацию о различных объектах, событиях и их связи между собой. Сведения из «графа знаний» обычно выводится справа от результатов поиска и предоставляет информацию по запросу, который ввел пользователь.

Это может быть, например, информация об актере, включая фильмы, в которых он снялся, и дату рождения. Озвучиванию будет подлежать, например, ответ на простые вопросы «Сколько долларов будет в 100 гривнах», «как называется столица Франции», «кто такой Мануэль Баррозу»

голосовой калькулятор

Поисковая система Google предлагает голосовой калькулятор Google , который позволяет с помощью устройств голосового ввода мгновенно получать ответ на любые, даже самые сложные расчеты.

Для запуска калькулятора нужно открыть Google Chrome и запустить google.com, лучше с открытым аккаунтом. Включаете устройство голосового ввода на компьютере и четко и ясно языком интерфейса Chrome произносите арифметическое действие. В поисковой строке появится калькулятор, на котором отображается действие и озвучено результат вычислений.

С калькулятором можно взаимодействовать вручную, мышкой или на цифровой клавиатуре набирая числа и переменные. В голосовом калькуляторе Google предусмотрено 15 алгебраических операций, со скобками, процентами, числом пи и е и другими переменными.

Голосовой переводчик Google

Google начал работы над универсальным переводчиком принципиально нового типа. Идея нового проекта заключается в создании сервиса, который позволит пользователям, общаются на разных языках, говорить друг с другом в режиме реального времени, причем именно «говорить», а не «переписываться». Иными словами переводчик должен распознать язык, перевести полученный в результате этого текст и воспроизвести его на другом языке.

Google Translate вполне успешно переводит тексты на 52 различных языка. Доработка уже существующих технологий до требуемого уровня займет еще несколько лет. Для перевода определенной фразы достаточно нажать на изображение микрофона в программе, сказать в микрофон нужные слова и программа автоматически отправит записанную речь на серверы Google, где состоится разбор звукового файла и перевод фразы. После текстового перевода можно прослушать произношение перевода и оригинального текста (синтезированный женский голос).

Google предупреждает, что пока функция носит экспериментальный характер, и не следует ожидать от нее 100% правильной работы.Правильном перевода могут помешать такие факторы как акцент, четкость произношения и посторонние шумы.

Для облачных сервисов Google применено несколько способов ввода текста. Сочетание редакторов IME или инструмента транслитерации ,виртуальных клавиатур и рукописного ввода позволяет поддерживать более 90 языков.

Как пользоваться различными способами ввода:

Распознавания рукописного текста в сервисах Google

Компания Google добавила к популярным сервисам функцию распознавания рукописного текста. Например, в Google Translate появилось специальное поле, поддерживает рукописный ввод данных.Например там можно нарисовать иероглиф и моментально узнать его точно обозначения. Новая возможность пригодится европейцам и американцам, изучающих азиатские языки (проект концентрируется именно на языках азиатских групп) и не знают их хитроумную письменность. На сегодня существует возможность распознавания текстов на украинском языке

На сегодня существует возможность распознавания текстов на украинском языке

Для ввода текста можно использовать мышку или тачпад, где есть нормальная поддержка рукописного ввода текста. Для начала работы с рукописным вводом следует включить соответствующую функцию в Gmail. В Google Docs достаточно будет использовать комбинацию Ctrl + Shift + K.

Новинка Google будут поэтапно включать для разных регионов, поэтому, такая функция может быть и отсутствует у пользователя. Для тех, кто печатает быстрее, чем пишет, подобная функция будет не нужна. Для пользователей, которые печатают языках, символов в которой больше, чем содержит стандартная клавиатура, нововведение может оказаться полезным.

https://support.google.com/plus/answer/2370300?hl=uk

Google вплотную занялась технологией распознавания лиц на фото. Для того, чтобы ускорить данный процесс, корпорация купила компанию PittPatt, которая занимается разработкой соответствующих технологий.PittPatt занимается не только распознаванием лиц на фотографиях, но и распознаванием фотографий вообще, с последующей разметкой (пометка) распознанных объектов.

Результаты разработок внедряются в различные программы и сервисы компании, как обычные, так и мобильные. Технология интегрируется в фото- и видеоприложения Picasa, Goggles, YouTube и Google+.

Я хотел бы услышать твое мнение про интеллект в интернет-технологиях распознавание изображений речи смысла Надеюсь, что теперь ты понял что такое интеллект в интернет-технологиях распознавание изображений речи смысла и для чего все это нужно, а если не понял, или есть замечания, то нестесняся пиши или спрашивай в комментариях, с удовольствием отвечу. Для того чтобы глубже понять настоятельно рекомендую изучить всю информацию из категории Распознавание образов

Ответы на вопросы для самопроверки пишите в комментариях, мы проверим, или же задавайте свой вопрос по данной теме.

Распознавание изображений. Документооборот. 1С

Внимание! СЭД “Корпоративный документооборот” заменен на новый продукт СЭД “Наш документооборот” оптимизированный и переписанный “с нуля”.

Внимание! Описание на этой странице потеряло актуальность.

Система документооборота «Корпоративный документооборот» включает в себя механизм распознавания текста из графических файлов. Механизм распознавания текста может использоваться для решения следующих задач:

- Извлечение текста для организации полнотекстового поиска по файлам системы документооборота

- Создание новых текстовых (а также html) файлов на основе графических файлов

Для включения возможности распознавать текст в изображениях необходимо включить функциональную опцию «Использовать распознавание» в настройках параметров системы на закладке «Работа с файлами» (подсистема «Администрирование системы»). После включения этой опции станут доступными следующие пункты:

- Настройка системы распознавания изображений

- Установить компоненту CuneiForm

- Сформировать очередь на распознавание изображений

Вид формы настройки системы приведен на рисунке ниже:

нажмите для увеличения изображения

В форме настройки системы распознавания изображений можно указать, какой язык используется в большинстве файлов, а также требуется ли изменять автора файла после его распознавания.

Язык распознавания в дальнейшем можно будет установить для каждого конкретного пользователя системы, а также для каждого файла системы. Поддерживается распознавание следующих языков:

Английский, Немецкий, Французский, Русский, Шведский, Испанский, Итальянский, Русско-Английский, Украинский, Сербский, Хорватский, Польский, Датский, Португальский, Голландский, Чешский, Румынский, Венгерский, Болгарский, Словенский, Латышский, Литовский, Эстонский, Турецкий.